카카오브레인은 멀티모달 언어모델 오픈소스 ‘허니비’를 공개했다고 19일 밝혔다.

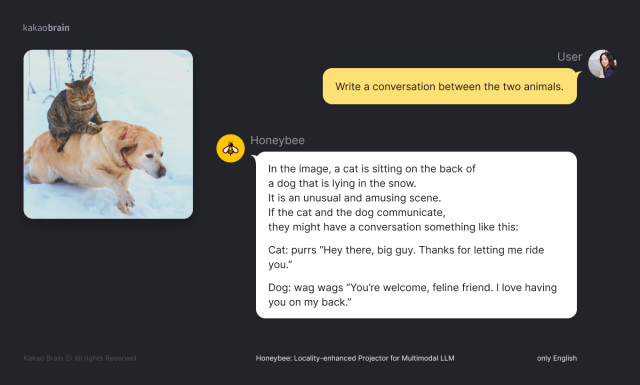

허니비 공개는 이미지와 대규모 언어모델을 연결할 수 있는 새로운 모듈을 제안하기 위해 이뤄졌다. 현재 멀티모달 언어모델에 대한 연구는 공개된 모델 수가 적고, 학습 방법 역시 자세히 공개되지 않아 개발이 어려운 상황이다.

이에 카카오브레인은 멀티모달 언어모델의 발전에 기여하고자 자체 개발한 ‘허니비’의 소스코드를 공개하기로 결정했다.

허니비는 각종 성능 실험에서 타사 MLLM 대비 최고 성능을 달성했다. 지각 능력과 인지 능력을 평가하는 ‘MME’ 벤치마크에서는 2800점 만점 중 1977점이라는 높은 점수를 획득했다.

관련 논문인 ‘허니비: 멀티모달 LLM을 위한 로컬리티 강화 프로젝터’는 지난해 논문 공개 사이트 ‘아카이브’에 게재됐다.

카카오브레인은 향후 허니비가 효과적인 교육 및 학습 보조 도구로 사용될 것으로 전망하고 있다.

김일두 카카오브레인 각자 대표는 “허니비 모델의 추론을 가능하게 하는 코드도 깃허브에 공개했다”며 “허니비를 활용한 각종 서비스 확장을 고려 중”이라고 밝혔다. 이어 “더욱 발전된 AI 모델 확보를 위해 끊임없이 연구⋅개발할 것”이라고 덧붙였다.

![[포토] 악수하는 이재명 대표와 권성동 원내대표](https://image.ajunews.com/content/image/2024/12/18/20241218150658549939_518_323.jpg)

![[포토] 겨울왕국 한라산](https://image.ajunews.com/content/image/2024/12/18/20241218134919258470_518_323.jpg)

![[포토] 경제부총리-외교장관 합동 외신기자 간담회](https://image.ajunews.com/content/image/2024/12/18/20241218113554802359_518_323.jpg)

![[포토] 아침 추위가 빚은 풍경](https://image.ajunews.com/content/image/2024/12/17/20241217114825954467_518_323.jpg)